Continua após a publicidade

Os modelos de inteligência artificial (IA) locais continuam a ser vistos como ferramentas complexas, reservadas apenas para programadores e especialistas em hardware. No entanto, a evolução das aplicações e da tecnologia tornou a IA local muito mais acessível do que muitos imaginam.

Continua após a publicidade

1️⃣ Executar modelos de IA localmente é apenas para especialistas

Existe a ideia de que apenas programadores experientes conseguem utilizar modelos de IA localmente. Durante algum tempo isso até foi verdade, sobretudo quando praticamente tudo exigia conhecimento de Linux, Python e linhas de comando.

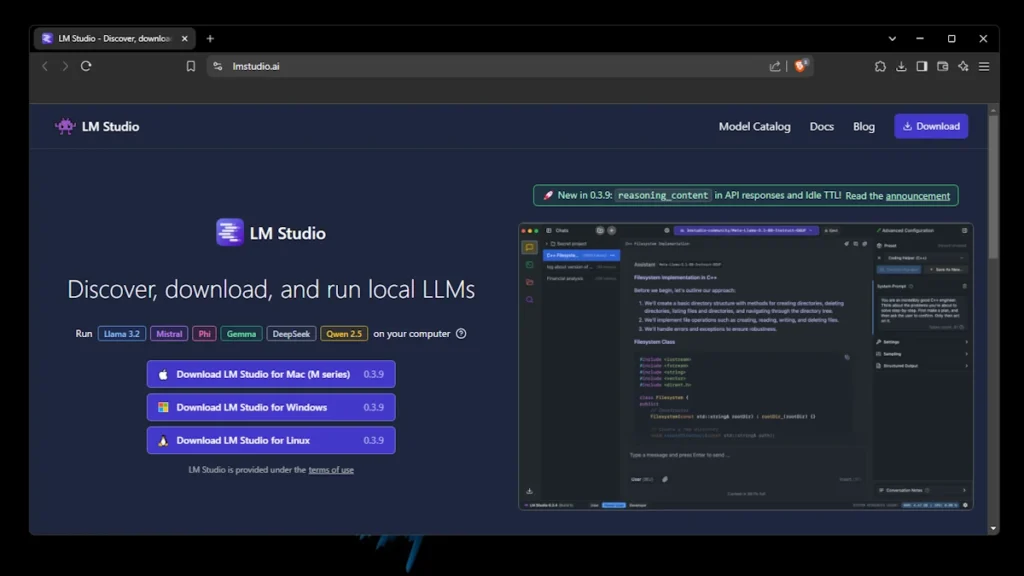

Hoje em dia, o cenário é completamente diferente. Aplicações modernas simplificaram o processo ao ponto de qualquer utilizador conseguir começar em poucos minutos. Ferramentas como GPT4All permitem instalar modelos de IA através de interfaces gráficas simples, sem necessidade de escrever comandos complicados.

Basta descarregar a aplicação, escolher um modelo disponível na biblioteca e iniciar imediatamente uma conversa com a IA.

Outro exemplo popular é LM Studio, que inclui um explorador de modelos integrado e uma interface de chat muito intuitiva. Para a maioria das pessoas, a dificuldade já não está na instalação, mas sim no receio inicial de experimentar algo que continua a parecer demasiado técnico.

2️⃣ O armazenamento é o maior problema

Um dos mitos mais comuns é a ideia de que os modelos de IA ocupam centenas de gigabytes e exigem discos gigantescos. Embora isso pudesse ser verdade há alguns anos, a evolução das técnicas de compressão mudou completamente o panorama.

Graças à quantização, muitos modelos modernos conseguem funcionar com tamanhos bastante reduzidos. Um modelo como Llama 3.1 na versão 8B pode ocupar menos de 5 GB de armazenamento, o que o torna mais leve do que muitos jogos atuais.

Mesmo modelos muito maiores, com dezenas de milhares de milhões de parâmetros, conseguem funcionar ocupando cerca de 40 a 50 GB. Naturalmente, um SSD rápido ajuda a reduzir os tempos de carregamento, mas o verdadeiro fator importante acaba por ser outro.

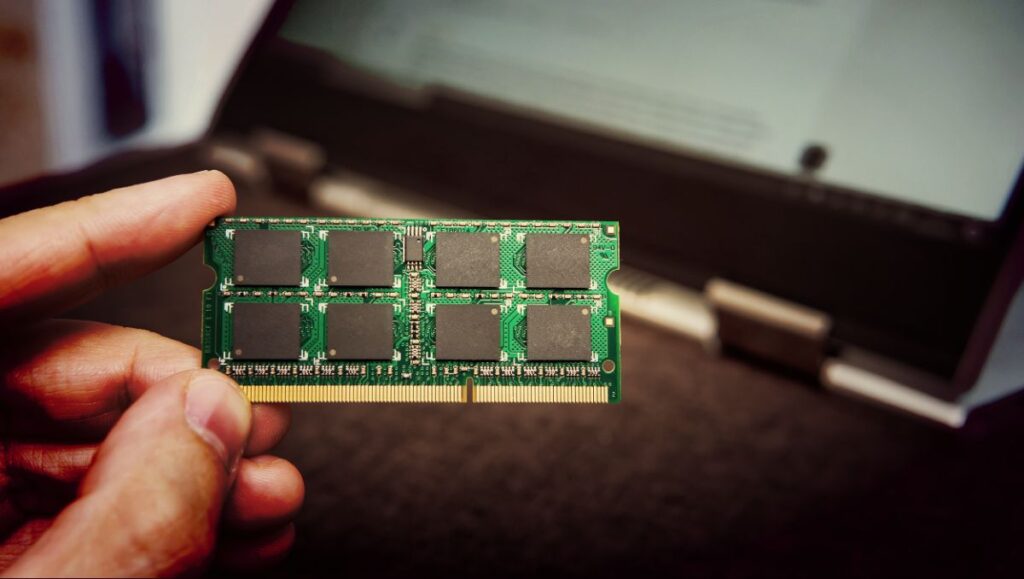

Quando o modelo já está em execução, a velocidade da memória passa a ter mais impacto do que o espaço livre em disco. Em ambientes locais, a quantidade de VRAM disponível determina se o modelo consegue arrancar, enquanto a largura de banda da memória influencia diretamente a rapidez das respostas.

Por outras palavras, não é necessário ter vários terabytes disponíveis para começar a explorar IA local em casa.

3️⃣ Os modelos locais estão muito longe de ser úteis

Muitas pessoas assumem automaticamente que um modelo executado num portátil comum será lento, limitado ou pouco inteligente. É verdade que um pequeno modelo local não consegue competir diretamente com os sistemas mais avançados alojados na cloud, que utilizam centenas de milhares de milhões de parâmetros. No entanto, para a maioria das tarefas do dia a dia, isso raramente é um problema.

Se o objetivo for criar projetos pessoais, gerar ideias, resumir documentos, escrever textos ou até ajudar em programação, os modelos locais atuais já oferecem resultados bastante impressionantes. Em muitos casos, a velocidade de resposta é surpreendente.

Modelos compactos como o Llama 3.1 8B conseguem gerar texto a velocidades superiores à capacidade média de leitura humana. Dependendo do hardware utilizado, é perfeitamente possível atingir mais de 90 tokens por segundo.

Claro que ferramentas profissionais na cloud continuam a ser superiores para tarefas extremamente complexas ou raciocínio avançado. Ainda assim, isso não significa que os modelos locais sejam fracos. Para utilização pessoal e produtividade diária, conseguem responder muito bem.

4️⃣ É preciso um computador de 2 mil euros

Outro erro frequente passa pela ideia de que executar IA local exige uma workstation topo de gama cheia de placas gráficas caríssimas. Na realidade, os avanços na quantização permitiram reduzir drasticamente os requisitos de hardware. Com modelos em 4-bit, é possível diminuir o consumo de memória em cerca de 75% sem perdas significativas de qualidade.

Isso significa que modelos com 7 ou 8 mil milhões de parâmetros conseguem funcionar utilizando apenas 4 a 8 GB de memória. Em muitos casos, um computador doméstico relativamente normal já é suficiente para começar.

Aplicações como GPT4All conseguem correr em máquinas mais antigas sem necessidade de uma placa gráfica dedicada. Para tarefas básicas de conversação e produtividade, o desempenho é mais do que aceitável. Existem até modelos leves capazes de correr em dispositivos tão modestos como um Raspberry Pi.

Ao mesmo tempo, computadores recentes com Apple Silicon tornaram-se excelentes plataformas para IA local graças à arquitetura de memória unificada. Isso permite que portáteis relativamente compactos consigam executar modelos que anteriormente exigiriam hardware muito mais caro.

Leia também:

Saiba mais sobre Inteligência Artificial

Publicidade